Objekterkennung mit CmuCam v5 (Pixy-Cam) mit Matlab/Simulink und EV3: Unterschied zwischen den Versionen

Keine Bearbeitungszusammenfassung |

Keine Bearbeitungszusammenfassung |

||

| Zeile 4: | Zeile 4: | ||

Die Aufgabe des Projekts "Objekterkennung mit CmuCam v5 (Pixy-Cam) mit Matlab/Simulink und EV3" ist einen Roboter mit Hilfe eines Farbsensors kurz vor einem in dem Weg stehenden Gegenstandes anhalten zu lassen. Es wird in sehr vereinfachter Form versucht ein Fahrerassistenzsystem, dass eine Notfallbremsung durchführt, nachzubilden. Bearbeitet wurde das Projekt von | Die Aufgabe des Projekts "Objekterkennung mit CmuCam v5 (Pixy-Cam) mit Matlab/Simulink und EV3" ist einen Roboter mit Hilfe eines Farbsensors kurz vor einem in dem Weg stehenden Gegenstandes anhalten zu lassen. Es wird in sehr vereinfachter Form versucht ein Fahrerassistenzsystem, dass eine Notfallbremsung durchführt, nachzubilden. Bearbeitet wurde das Projekt von [[Benutzer:Gesina-Kira Tigger| Gesina Kira Tigger]] in dem Modul "Signalverarbeitende Systeme" des Masterstudiengangs "Business and Systems Engineering" unter [[Benutzer:Ulrich_Schneider| Prof. Schneider]] als Betreuer. <br/> | ||

Zunächst wird der vorgegebene Sensor mit seinen Funktionen und Übergabeparameter beschrieben. Des Weiteren folgen Ausführungen zur Signalvorverarbeitung, Analog-Digital-Umsetzer und Bussystem. Abschließend wird die digitale Signalverarbeitung und die Darstellung der Ergebnisse thematisiert. | Zunächst wird der vorgegebene Sensor mit seinen Funktionen und Übergabeparameter beschrieben. Des Weiteren folgen Ausführungen zur Signalvorverarbeitung, Analog-Digital-Umsetzer und Bussystem. Abschließend wird die digitale Signalverarbeitung und die Darstellung der Ergebnisse thematisiert. | ||

Version vom 16. Juni 2017, 11:16 Uhr

Autoren: Gesina Kira Tigger

Betreuer: Prof. Schneider

Die Aufgabe des Projekts "Objekterkennung mit CmuCam v5 (Pixy-Cam) mit Matlab/Simulink und EV3" ist einen Roboter mit Hilfe eines Farbsensors kurz vor einem in dem Weg stehenden Gegenstandes anhalten zu lassen. Es wird in sehr vereinfachter Form versucht ein Fahrerassistenzsystem, dass eine Notfallbremsung durchführt, nachzubilden. Bearbeitet wurde das Projekt von Gesina Kira Tigger in dem Modul "Signalverarbeitende Systeme" des Masterstudiengangs "Business and Systems Engineering" unter Prof. Schneider als Betreuer.

Zunächst wird der vorgegebene Sensor mit seinen Funktionen und Übergabeparameter beschrieben. Des Weiteren folgen Ausführungen zur Signalvorverarbeitung, Analog-Digital-Umsetzer und Bussystem. Abschließend wird die digitale Signalverarbeitung und die Darstellung der Ergebnisse thematisiert.

Auswahl eines Primärsensors

Wie funktioniert der Sensor? Welche Rohsignale liefert der Sensor?

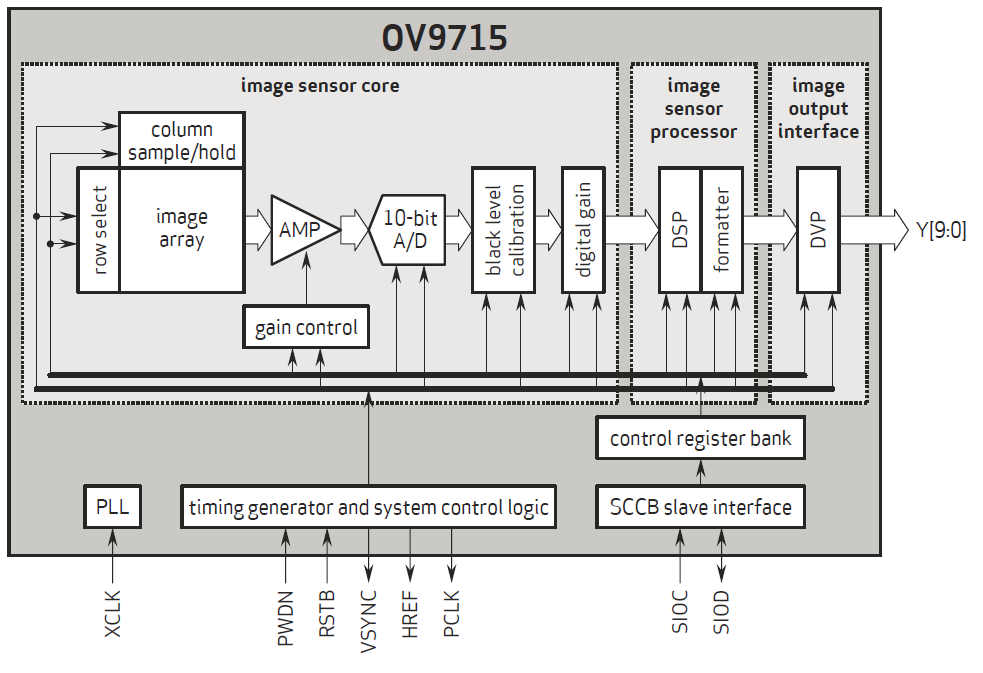

In der Pixy ist der Video-Bild-Sensor Omnivision OV9715 (1/4") verbaut. Der Sensor hat die folgenden Spezifikationen: - active Array size: 1280x800 - power supply: -- core: 1.5 VDC +- 5% (built-in Regulator) -- analog: 3.0 - 3.6V -- I/O: 1.7 - 3.6V - power requirements: -- active: 110mW -- standby: 50microA - output format: 10-bit raw RGB data - lens size: 1/4" - lens Chief ray angle: 0° - input clock frequency: 6-27MHz - scan mode: progressive - ... (OmniVision 2012)

Signalvorverarbeitung

Sollen Messwerte oder vorverarbeitete Daten übertragen werden? Wie lässt sich eine Vorverarbeitung umsetzen? Wird eine Kennlinie eingesetzt? Wenn ja, wie wird diese kalibriert?

Analog-Digital-Umsetzer

Wie werden die analogen Signale umgesetzt? Welcher ADU kommt zum Einsatz? Welche Gründe sprechen für diesen ADU? Alternativen?

Bussystem

Wird ein Bussystem zwischen Sensor und Mikrocontroller eingesetzt? Wenn ja, wie funktioniert dieses Bussystem?

Digitale Signalverarbeitung

Welche Verarbeitungsschritte sind notwendig? Welche Filter werden angewendet? Bestimmen Sie Auflösung, Empfindlichkeit und Messunsicherheit des Sensors.

Darstellung der Ergebnisse

Welche Fehler treten in welchem Verarbeitungsschritt auf? Stellen Sie die Messunsicherheit bzw. das Vertrauensintervall dar.

Weiterführende Links und Quellen

→ zurück zum Hauptartikel: Signalverarbeitende Systeme SoSe2017