Objekttracking mit LiDAR: Unterschied zwischen den Versionen

| (222 dazwischenliegende Versionen von 2 Benutzern werden nicht angezeigt) | |||

| Zeile 1: | Zeile 1: | ||

Autoren: [[Benutzer:Ahmad Hassan|Ahmad Hassan]], [[Benutzer:Lihui Liu|Lihui Liu]] | Autoren: [[Benutzer:Ahmad Hassan|Ahmad Hassan]], [[Benutzer:Lihui Liu|Lihui Liu]] | ||

== Einleitung == | == Einleitung == | ||

Die Gruppe Hassan/Liu beschäftigt sich im Wintersemester 2020/2021 mit dem Thema Objekterkennung und Objekttracking mit dem Hokuyo LiDAR. Im Sommersemester wurde schon ein Arbeitskonzept dazu entworfen inkl. einem Signalflussplan sowie einem morphologischen Kasten. In dem WS20/21 soll eine Umsetzung dieses Arbeitskonzepts in C erfolgen. Zuerst kommt die Einbindung bzw. Einrichtung und Ansteuerung des LiDARs in C. Darauffolgend wird die Koordinatentransformation implementiert. Zum Testen des Schnittstellenkommunikationsprinzips wird auch eine Funktion programmiert, die innerhalb des ersten Monats des Semesters eine Dummy Objektliste erstellt, die an die DS1104 verschickt werden kann anhand von dem vom Team Heuer/Kruse entwickelten Kommunikationsframework. Zukünftig dient diese Funktion dem Versand der tatsächlichen, erfassten Objekte und ihrer Attribute. | Die Gruppe Hassan/Liu beschäftigt sich im Wintersemester 2020/2021 mit dem Thema Objekterkennung und Objekttracking mit dem Hokuyo LiDAR. Im Sommersemester wurde schon ein Arbeitskonzept dazu entworfen inkl. einem Signalflussplan sowie einem morphologischen Kasten. In dem WS20/21 soll eine Umsetzung dieses Arbeitskonzepts in C/C++ erfolgen. Zuerst kommt die Einbindung bzw. Einrichtung und Ansteuerung des LiDARs in C/C++. Darauffolgend wird die Koordinatentransformation implementiert. Zum Testen des Schnittstellenkommunikationsprinzips wird auch eine Funktion programmiert, die innerhalb des ersten Monats des Semesters eine Dummy Objektliste erstellt, die an die DS1104 verschickt werden kann anhand von dem vom Team Heuer/Kruse entwickelten Kommunikationsframework. Zukünftig dient diese Funktion dem Versand der tatsächlichen, erfassten Objekte und ihrer Attribute. Danach kommt eine Implementierung der Segmentierung. Allerdings wird hier die Successive Edge Following genommen statt der Connected Component Clustering im Gegensatz zu dem aus dem SS20/21 resultierenden Konzept. Anschließend erfolgt die Umsetzung der Komponenten Objektbildung, Datenzuordnung und das Gating. An letzter Stelle findet die Programmierung des Kalman-Filters zur Objektverfolgung und Schätzung der Attribute wie Geschwindigkeit und Beschleunigung der verfolgten Objekte statt. | ||

Eine detaillierte Beschreibung der erforderlichen, fachlichen Grundlagen und des entwickelten Konzepts ist im [https://wiki.hshl.de/wiki/index.php?title=Objekterkennung_mit_Hokuyo_LiDAR&oldid=65410: Objekterkennung mit Hokuyo LiDAR] zu finden. | Eine detaillierte Beschreibung der erforderlichen, fachlichen Grundlagen und des entwickelten Konzepts ist im [https://wiki.hshl.de/wiki/index.php?title=Objekterkennung_mit_Hokuyo_LiDAR&oldid=65410: Objekterkennung mit Hokuyo LiDAR] zu finden. | ||

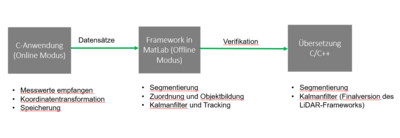

Vorgehensweise war, dass Datensätze erstmal mit einer LiDAR C-Anwendung aufgenommen werden. Zweiter Schritt war diese Datensätze in ein MatLab Framework (Offline-Betrieb) einzulesen, in dem die von den oben erwähnten Komponenten verarbeitet werden. Ziel dahinter war die Verifikation der Lauffähigkeit einer Funktion vor Beginn der Überführung dieser Funktion in C/C++ | |||

[[Datei:Vorgehensweise_zur_Verifikation.PNG|400px|thumb|center|Alternativer Text]] | |||

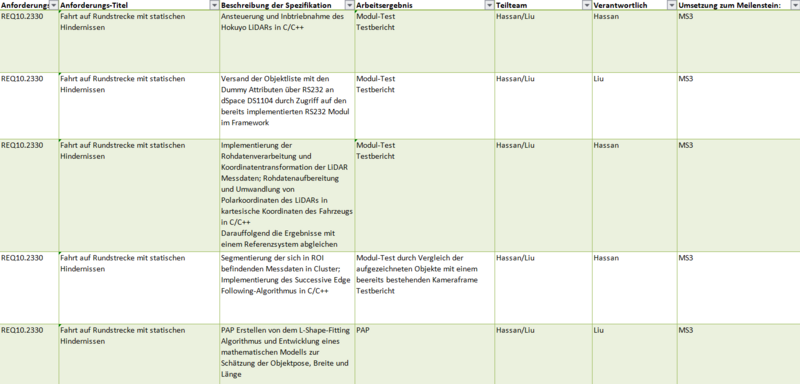

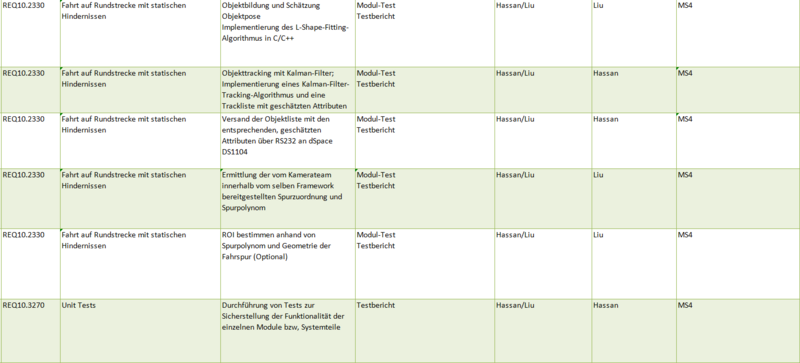

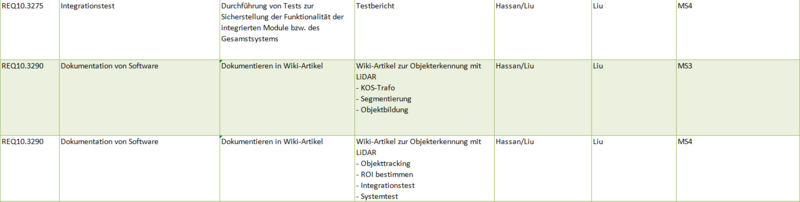

Eine Auflistung der Aufgaben zu den entsprechenden Meilensteinen ist unten ersichtlich. | Eine Auflistung der Aufgaben zu den entsprechenden Meilensteinen ist unten ersichtlich. | ||

| Zeile 20: | Zeile 24: | ||

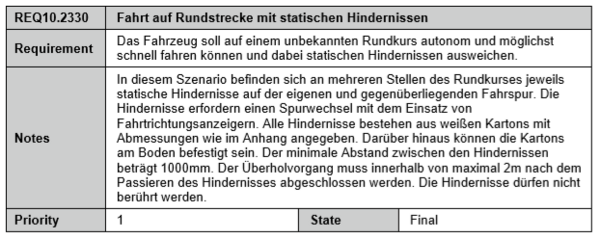

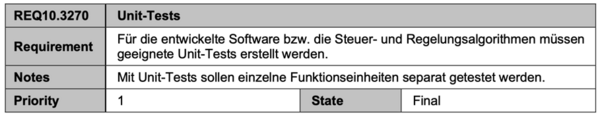

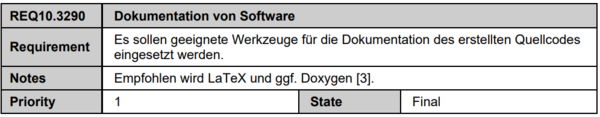

== Anforderungen == | == Anforderungen == | ||

[[Datei:REQ10.2330.PNG|600px |thumb| none |Abbildung 1 der Anforderung]] | [[Datei:REQ10.2330.PNG|600px |thumb| none |Abbildung 2.1: der Anforderung]] | ||

[[Datei:REQ10_3275.PNG|600px|thumb| none |Abbildung 2 der Anforderung]] | [[Datei:REQ10_3275.PNG|600px|thumb| none |Abbildung 2.2: der Anforderung]] | ||

[[Datei:REQ10_3290.PNG|600px|thumb| none |Abbildung 3 der Anforderung]] | [[Datei:REQ10_3290.PNG|600px|thumb| none |Abbildung 2.3: der Anforderung]] | ||

== Pflichten == | == Pflichten == | ||

Die vorgenommenen Pflichten zeigen die folgenden Abbildungen:<br> | Die vorgenommenen Pflichten zeigen die folgenden Abbildungen:<br> | ||

[[Datei:Pflichtheft | [[Datei:Pflichtheft(1).PNG|800px |thumb| none |Abbildung 3.1: Pflichtheft Teil1]] | ||

[[Datei:Pflichtheft | [[Datei:Pflichtheft(2).PNG|800px |thumb| none |Abbildung 3.2: Pflichtheft Teil2]] | ||

[[Datei:Pflichtheft | [[Datei:Pflichtheft(3).PNG|800px |thumb| none |Abbildung 3.3: Pflichtheft Teil3]] | ||

<br> | <br> | ||

== Funktionaler Systementwurf / Technischer Systementwurf == | == Funktionaler Systementwurf / Technischer Systementwurf == | ||

==== Inbetriebnahme und Ansteuerung des LiDARs / Koordinatentransformation ==== | |||

Damit eine Programmierung der Teilfunktionen in MatLab und in C/C++ im Anschluss an ihrer Lauffähigkeitsverifikation möglich ist, ist die Bereitstellung von Datensätzen erforderlich. Es muss also eine Verbindung mit dem LiDAR hergestellt werden und reale Messdaten in Echtzeit aufgenommen und transformiert werden. | |||

==== Erstellung einer Dummy Objektliste zum Testen des Schnittstellenkommunikationsprinzips für LiDAR Daten ==== | |||

Um das Kommunikationsprinzip von dem Team Heuer/Kruse im Hinblick auf LiDAR Objekte ohne Integration zu testen, werden Dummyparameter in Form einer Objektliste generiert.Diese sieht folgendermaßen aus. | |||

{| class="mw-datatable" | |||

! style="font-weight: bold;" | Signal | |||

! style="font-weight: bold;" | Bedeutung | |||

! style="font-weight: bold;" | Datentype | |||

|- | |||

| nObjekte | |||

| Gesamtanzahl der relevanten Objekte (max. 5) | |||

| u8 | |||

|- | |||

| Objekt[n].Nummer | |||

| Objektzähler | |||

| u8 | |||

|- | |||

| Objekt[n].x0 | |||

| x-Koordinate des Objektmittelpunktes (mitte, vorn) | |||

| f32 | |||

|- | |||

| Objekt[n].y0 | |||

| y-Koordinate des Objektmittelpunktes (mitte, vorn) | |||

| f32 | |||

|- | |||

| Objekt[n].b | |||

| Objektbreite | |||

| f32 | |||

|- | |||

| Objekt[n].t | |||

| Objekttiefe | |||

| f32 | |||

|- | |||

| Objekt[n].alpha | |||

| Objektausrichtung | |||

| f32 | |||

|- | |||

| Objekt[n].v | |||

| Betrag des Geschwindigkeitsvektors | |||

| f32 | |||

|- | |||

| Objekt[n].Plausibel | |||

| Vertrauenswert für das Objekt (100: 100% vertrauenswürdig) | |||

| u8 | |||

|} | |||

<br> | |||

==== Segmentierung: Successive Edge Following ==== | |||

Bei der Successive Edge Following werden alle von dem LiDAR empfangenen Messdaten aus derselben Punktwolke in einem Array abgelegt. Danach wird der erste Punkt in dem Array als der erste Punkt des ersten Segments in dieser Punktwolke angesehen. Die Distanz zwischen diesem Punkt und seinem benachbarten Punkt wird berechnet und mit einem dynamisch berechneten Schwellwert verglichen. Der Schwellwert muss dynamisch berechnet werden, da sich der Öffnungswinkel des LiDARs in Abhängigkeit von Distanz zu Objekten ändert. Das kann zu Ober- oder Untersegmentierung führen. Ist die Distanz kleiner als der Schwellwert, gehört dieser Punkt zu dem aktuellen Segment und es wird ab ihm genauso weiter vorgegangen. Ist die berechnete Distanz größer als der Schwellwert, wird das Segment abgeschlossen. Jedes Segment wird weiter definiert, indem sein Mittelpunkt ermittelt wird sowie der Punkt am weitesten Rechts und am weitesten Links. Das geht relativ einfach, da mit dem beschriebenen Vorgang, der Rechtste Punkt immer der erste Punkt des Segments ist während der linkste Punkt der letzte ist. | |||

== | ==== Objektbildung ==== | ||

In diesem Artikel werden verschiedene Fahrtszenarien dargestellt. Darauf aufbauend wird ein Ansatz zur Objektbildung bzw. Beschreibung der Hindernisse entwickelt. | |||

<br> | |||

'''Hier gehts zu Artikel''' [[Datei:Ezgif-3-aa149494be25.gif]] [https://wiki.hshl.de/wiki/index.php/Objektbildung Objektbildung] | |||

==== | ==== Tracking ==== | ||

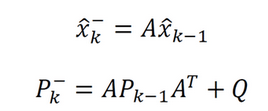

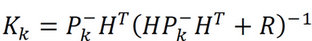

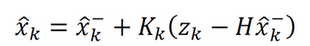

Die Segmentierung liefert eine Segmentliste. Jedes Segment wird an der Objektbildung übergeben, um ein Objekt daraus zu machen. Stellvertreter jedes Objektes ist der Mittelpunkt der Vorderkante. Beim ersten Durchlauf bilden alle Mittelpunkte bzw. Objekte neue Tracks. Hiernach passiert der Prädikitionsschritt des Kalmanfilters | |||

[[Datei:Prediction.PNG|400px|thumb|none]] | |||

[[Datei:gain.PNG|400px|thumb|none]] | |||

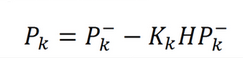

Sobald eine neue Liste von Objekten ankommt im Zyklus k findet eine Datenzuordnung statt über ein Munkres-Algorithmus, um die neuen Objekte den Prädiktionen des Kalman-Filters aus dem vorigen Zyklus k-1 zuzuordnen. Zur Vereinfachung der Distanzmatrix, die an dem Munkres übergeben wird, kommt ein euklidisches Gating zum Einsatz. Nach der Datenzuordnung findet der Korrekturschritt des Kalman-Filters statt | |||

[[Datei:correct.PNG|400px|thumb|none]] | |||

[[Datei:correct2.PNG|400px|thumb|none]] | |||

Tracks, denen keine Messungen für eine gewisse Anzahl an Durchläufen zugeordnet worden sind, werden gelöscht. Neue Messungen, die keinem bestehenden Track zugeordnet worden sind, bilden neue Tracks. Somit erfolgt die Aktualisierung der Trackliste. | |||

==== | == Programmierung in MatLab (Offline Framework) == | ||

Alle Komponenten inkl. Segmentierung, Objektbildung, Datenzuordnung und Gating, Tracking sind zusammen in dem folgenden MatLab Framework integriert. | |||

[https://svn.hshl.de/svn/MTR_SDE_Praktikum/trunk/Teams/OSE/OSE_LiDAR_Tracking/Hokuyo LiDAR Framework_Mat_Vison_2] | |||

=== | === Segmentierung: Successive Edge Following === | ||

In dem oben verlinkten Ordner ist die Segmentierung: | |||

# getSegs.mat | |||

# defSegs.mat | |||

== | === Objektbildung === | ||

[https://svn.hshl.de/svn/MTR_SDE_Praktikum/trunk/Teams/OSE/OSE_LiDAR_Tracking/Objektbildung/] | |||

=== | === Objekttracking === | ||

In dem oben verlinkten Ordner ist der Tracking Algorithmus | |||

# PraediziereTrack.m - Kalman Filter Prädikition | |||

# Zuordnung.m - Zuordnung und Gating | |||

# KalmanFilter.m - KalmanKorrektur | |||

==== | == Programmierung in C/C++ (Online Framework)== | ||

=== Inbetriebnahme und Ansteuerung des LiDARs / Koordinatentransformation === | |||

[https://svn.hshl.de/svn/MTR_SDE_Praktikum/trunk/Teams/OSE/OSE_LiDAR_Tracking/LiDAR_Tracking_Software_C/Test_LiDAR/] | |||

=== | === Erstellung einer Dummy Objektliste zum Testen des Schnittstellenkommunikationsprinzips für LiDAR Daten === | ||

[https://svn.hshl.de/svn/MTR_SDE_Praktikum/trunk/Teams/OSE/OSE_LiDAR_Tracking/LiDAR_Tracking_Software_C/Objektliste(1)/] | |||

=== | === Segmentierung=== | ||

[https://svn.hshl.de/svn/MTR_SDE_Praktikum/trunk/Teams/OSE/OSE_LiDAR_Tracking/Segmentierung%20Testumgebung%20C++//] | |||

=== | === Kalman Filter=== | ||

Hierfür wird die Bibliothek Eigen benötigt | |||

[https://svn.hshl.de/svn/MTR_SDE_Praktikum/trunk/Teams/OSE/OSE_LiDAR_Tracking/LiDAR_Tracking_Software_C-C++/KalmanTest/] | |||

== Komponententest == | == Komponententest == | ||

=== Laufzeit CCC gegenüber SEF === | |||

[https://svn.hshl.de/svn/MTR_SDE_Praktikum/trunk/Teams/OSE/OSE_LiDAR_Tracking/Vergleich%20SEF%20und%20CCC_%20PerformanceProfiler/] | |||

== Zusammenfassung und Ergebnisse == | |||

=== Segmentierung in MatLab=== | |||

[[Datei:Segmentierung.mp4|800px|thumb|none]] | |||

=== Objektbildung in MatLab=== | |||

[[Datei:OBMat.mp4|800px|thumb|none]] | |||

=== Framework in MatLab=== | |||

In dem Offline Framework in MatLab sind alle Komponenten inkl. Segmentierung, Objektbildung, Datenzuordnung und Gating sowie das Kalmanfilter zusammenintegriert und verfiziert worden. | |||

[[Datei:TrackingMat.mp4|8000px|thumb|none]] | |||

== | === Segmentierung in C++ === | ||

[[Datei:Segmentierung_2.mp4|400px|thumb|none]] | |||

== | === Framework in C++ === | ||

Da bis Ende Meilenstein 4 noch keine Objektbildung oder Datenzuordnung implementiert wurde, wurde das in C++ umgesetzte Kalman Filter in dem Live C++ LiDAR Framework von Team Arndt/Köhler eingesetzt [https://wiki.hshl.de/wiki/index.php/OSE_-_Objekterkennung_und_-verfolgung_mittels_LiDAR_WS20/21] | |||

== Ausblick == | |||

* Die Koordinatentransformation des LiDAR-Faremworks in C muss mehrmals getestet werden | |||

* Integrationstest | |||

* Kalman-Filter Parametrisierung für das autonome Fahrzeug | |||

* Bestimmung der ROI anhand von Spurpolynom und Spurzuordnung | |||

* Übertragung echter LiDAR Daten nach Integration in Kommunikationsmodul | |||

-------------------------- | -------------------------- | ||

→ zurück zum Gruppenartikel: [[SDE-Team_2020/21|SDE-Team_2020/21]]<br> | → zurück zum Gruppenartikel: [[SDE-Team_2020/21|SDE-Team_2020/21]]<br> | ||

→ zurück zum Hauptartikel: [[Praktikum_SDE|SDE Praktikum Autonomes Fahren]] | → zurück zum Hauptartikel: [[Praktikum_SDE|SDE Praktikum Autonomes Fahren]] | ||

Aktuelle Version vom 12. Februar 2021, 23:06 Uhr

Autoren: Ahmad Hassan, Lihui Liu

Einleitung

Die Gruppe Hassan/Liu beschäftigt sich im Wintersemester 2020/2021 mit dem Thema Objekterkennung und Objekttracking mit dem Hokuyo LiDAR. Im Sommersemester wurde schon ein Arbeitskonzept dazu entworfen inkl. einem Signalflussplan sowie einem morphologischen Kasten. In dem WS20/21 soll eine Umsetzung dieses Arbeitskonzepts in C/C++ erfolgen. Zuerst kommt die Einbindung bzw. Einrichtung und Ansteuerung des LiDARs in C/C++. Darauffolgend wird die Koordinatentransformation implementiert. Zum Testen des Schnittstellenkommunikationsprinzips wird auch eine Funktion programmiert, die innerhalb des ersten Monats des Semesters eine Dummy Objektliste erstellt, die an die DS1104 verschickt werden kann anhand von dem vom Team Heuer/Kruse entwickelten Kommunikationsframework. Zukünftig dient diese Funktion dem Versand der tatsächlichen, erfassten Objekte und ihrer Attribute. Danach kommt eine Implementierung der Segmentierung. Allerdings wird hier die Successive Edge Following genommen statt der Connected Component Clustering im Gegensatz zu dem aus dem SS20/21 resultierenden Konzept. Anschließend erfolgt die Umsetzung der Komponenten Objektbildung, Datenzuordnung und das Gating. An letzter Stelle findet die Programmierung des Kalman-Filters zur Objektverfolgung und Schätzung der Attribute wie Geschwindigkeit und Beschleunigung der verfolgten Objekte statt. Eine detaillierte Beschreibung der erforderlichen, fachlichen Grundlagen und des entwickelten Konzepts ist im Objekterkennung mit Hokuyo LiDAR zu finden.

Vorgehensweise war, dass Datensätze erstmal mit einer LiDAR C-Anwendung aufgenommen werden. Zweiter Schritt war diese Datensätze in ein MatLab Framework (Offline-Betrieb) einzulesen, in dem die von den oben erwähnten Komponenten verarbeitet werden. Ziel dahinter war die Verifikation der Lauffähigkeit einer Funktion vor Beginn der Überführung dieser Funktion in C/C++

Eine Auflistung der Aufgaben zu den entsprechenden Meilensteinen ist unten ersichtlich.

- Meilenstein 3:

- Implementierung der Einbindung und Ansteuerung des Hokuyo LiDAR

- Implementierung der Koordinatentransformation

- Testdokumentation der Koordinatentransformation

- Versand einer Dummy-Objektliste an DS1104

- Implementierung der Segmentierung (Connected Component Clustering)

- Erstellen eines PAPs zum L-Shape Fitting Algorithmus

- Meilenstein 4:

- Implementierung des L-Shape Fitting Algorithmus

- Implementierung des Kalman Filters

- Attribute schätzen

- Versand der echten Objektlisten an die dSpace-Karte

- Dokumentation im Wiki

Anforderungen

Pflichten

Die vorgenommenen Pflichten zeigen die folgenden Abbildungen:

Funktionaler Systementwurf / Technischer Systementwurf

Inbetriebnahme und Ansteuerung des LiDARs / Koordinatentransformation

Damit eine Programmierung der Teilfunktionen in MatLab und in C/C++ im Anschluss an ihrer Lauffähigkeitsverifikation möglich ist, ist die Bereitstellung von Datensätzen erforderlich. Es muss also eine Verbindung mit dem LiDAR hergestellt werden und reale Messdaten in Echtzeit aufgenommen und transformiert werden.

Erstellung einer Dummy Objektliste zum Testen des Schnittstellenkommunikationsprinzips für LiDAR Daten

Um das Kommunikationsprinzip von dem Team Heuer/Kruse im Hinblick auf LiDAR Objekte ohne Integration zu testen, werden Dummyparameter in Form einer Objektliste generiert.Diese sieht folgendermaßen aus.

| Signal | Bedeutung | Datentype |

|---|---|---|

| nObjekte | Gesamtanzahl der relevanten Objekte (max. 5) | u8 |

| Objekt[n].Nummer | Objektzähler | u8 |

| Objekt[n].x0 | x-Koordinate des Objektmittelpunktes (mitte, vorn) | f32 |

| Objekt[n].y0 | y-Koordinate des Objektmittelpunktes (mitte, vorn) | f32 |

| Objekt[n].b | Objektbreite | f32 |

| Objekt[n].t | Objekttiefe | f32 |

| Objekt[n].alpha | Objektausrichtung | f32 |

| Objekt[n].v | Betrag des Geschwindigkeitsvektors | f32 |

| Objekt[n].Plausibel | Vertrauenswert für das Objekt (100: 100% vertrauenswürdig) | u8 |

Segmentierung: Successive Edge Following

Bei der Successive Edge Following werden alle von dem LiDAR empfangenen Messdaten aus derselben Punktwolke in einem Array abgelegt. Danach wird der erste Punkt in dem Array als der erste Punkt des ersten Segments in dieser Punktwolke angesehen. Die Distanz zwischen diesem Punkt und seinem benachbarten Punkt wird berechnet und mit einem dynamisch berechneten Schwellwert verglichen. Der Schwellwert muss dynamisch berechnet werden, da sich der Öffnungswinkel des LiDARs in Abhängigkeit von Distanz zu Objekten ändert. Das kann zu Ober- oder Untersegmentierung führen. Ist die Distanz kleiner als der Schwellwert, gehört dieser Punkt zu dem aktuellen Segment und es wird ab ihm genauso weiter vorgegangen. Ist die berechnete Distanz größer als der Schwellwert, wird das Segment abgeschlossen. Jedes Segment wird weiter definiert, indem sein Mittelpunkt ermittelt wird sowie der Punkt am weitesten Rechts und am weitesten Links. Das geht relativ einfach, da mit dem beschriebenen Vorgang, der Rechtste Punkt immer der erste Punkt des Segments ist während der linkste Punkt der letzte ist.

Objektbildung

In diesem Artikel werden verschiedene Fahrtszenarien dargestellt. Darauf aufbauend wird ein Ansatz zur Objektbildung bzw. Beschreibung der Hindernisse entwickelt.

Hier gehts zu Artikel ![]() Objektbildung

Objektbildung

Tracking

Die Segmentierung liefert eine Segmentliste. Jedes Segment wird an der Objektbildung übergeben, um ein Objekt daraus zu machen. Stellvertreter jedes Objektes ist der Mittelpunkt der Vorderkante. Beim ersten Durchlauf bilden alle Mittelpunkte bzw. Objekte neue Tracks. Hiernach passiert der Prädikitionsschritt des Kalmanfilters

Sobald eine neue Liste von Objekten ankommt im Zyklus k findet eine Datenzuordnung statt über ein Munkres-Algorithmus, um die neuen Objekte den Prädiktionen des Kalman-Filters aus dem vorigen Zyklus k-1 zuzuordnen. Zur Vereinfachung der Distanzmatrix, die an dem Munkres übergeben wird, kommt ein euklidisches Gating zum Einsatz. Nach der Datenzuordnung findet der Korrekturschritt des Kalman-Filters statt

Tracks, denen keine Messungen für eine gewisse Anzahl an Durchläufen zugeordnet worden sind, werden gelöscht. Neue Messungen, die keinem bestehenden Track zugeordnet worden sind, bilden neue Tracks. Somit erfolgt die Aktualisierung der Trackliste.

Programmierung in MatLab (Offline Framework)

Alle Komponenten inkl. Segmentierung, Objektbildung, Datenzuordnung und Gating, Tracking sind zusammen in dem folgenden MatLab Framework integriert. LiDAR Framework_Mat_Vison_2

Segmentierung: Successive Edge Following

In dem oben verlinkten Ordner ist die Segmentierung:

- getSegs.mat

- defSegs.mat

Objektbildung

Objekttracking

In dem oben verlinkten Ordner ist der Tracking Algorithmus

- PraediziereTrack.m - Kalman Filter Prädikition

- Zuordnung.m - Zuordnung und Gating

- KalmanFilter.m - KalmanKorrektur

Programmierung in C/C++ (Online Framework)

Inbetriebnahme und Ansteuerung des LiDARs / Koordinatentransformation

Erstellung einer Dummy Objektliste zum Testen des Schnittstellenkommunikationsprinzips für LiDAR Daten

Segmentierung

Kalman Filter

Hierfür wird die Bibliothek Eigen benötigt

Komponententest

Laufzeit CCC gegenüber SEF

Zusammenfassung und Ergebnisse

Segmentierung in MatLab

Objektbildung in MatLab

Framework in MatLab

In dem Offline Framework in MatLab sind alle Komponenten inkl. Segmentierung, Objektbildung, Datenzuordnung und Gating sowie das Kalmanfilter zusammenintegriert und verfiziert worden.

Segmentierung in C++

Framework in C++

Da bis Ende Meilenstein 4 noch keine Objektbildung oder Datenzuordnung implementiert wurde, wurde das in C++ umgesetzte Kalman Filter in dem Live C++ LiDAR Framework von Team Arndt/Köhler eingesetzt [7]

Ausblick

- Die Koordinatentransformation des LiDAR-Faremworks in C muss mehrmals getestet werden

- Integrationstest

- Kalman-Filter Parametrisierung für das autonome Fahrzeug

- Bestimmung der ROI anhand von Spurpolynom und Spurzuordnung

- Übertragung echter LiDAR Daten nach Integration in Kommunikationsmodul

→ zurück zum Gruppenartikel: SDE-Team_2020/21

→ zurück zum Hauptartikel: SDE Praktikum Autonomes Fahren